安心して利用できるAI、信頼されるAIを実現するために AI倫理技術

さまざまな分野でAIの適用が広がり、生成AIなど新技術が開発されています。その一方で、AIが引き起こす倫理的な問題が明るみになってきています。安心して利用できるAI、信頼されるAIを実現するために、富士通は、法やガイドラインを遵守し、社会価値や規範に沿った、社会に受け入れられるAIの提供に取り組みます。

AI倫理技術に関する最新情報はこちら

- 2025年5月30日 第39回人工知能学会全国大会において、富士通とお茶の水女子大学によるオーガナイズドセッション「AI技術開発におけるジェンダード・イノベーションと公平性」が開催されました。

- 2025年5月28日 Global Partnership on AI (GPAI)関連プロジェクトのワークショップである「東京イノベーションワークショップ」に富士通研究所のメンバーが参加しました。

- 2025年5月25日 JSTムーンショット 自在ホンヤク機研究開発 第三回 ELSI検討会に、富士通の中尾悠里リサーチディレクターが登壇しました。

- 2025年4月27日 STAIG@CHI‘25 で、AI監査へのステークホルダー参加についての論文発表を行いました。

- 2025年4月27日 STAIG@CHI’25 で、生成AIの透明性・アカウンタビリティに関する考察論文の発表を行いました。

- 2025年4月27日 STAIG@CHI’25のパネルディスカッションに、富士通の中尾悠里シニアリサーチマネージャーが登壇しました。

- 2025年4月18日 「AKOS AI、富士通のAIトラスト技術を活用し、AIシステムへの欧州AI規制法対応を支援するサービスを提供開始」と題して、プレスリリースを行いました。

技術開発・活動の概要

富士通は、法やガイドラインの遵守および、AIを安心・安全に設計・開発・運用する技術開発に取り組んでいます。また、人とAIの協調による社会課題の解決にチャレンジし、よりサステイナブルな社会の実現を目指します。

技術開発・活動の4つの柱

法・ガイドラインの遵守

現在は、AIの開発および、その利活用のあり方が法制化され、遵守が求められます。EUではAI法案が採択され、2026年にはEU域内でAI開発・利用における法令遵守が必須となります。

活動:国際フォーラムへの参画

富士通は、欧州最大のAI倫理機関であるAI4Peopleに加盟し、AIの利活用による社会への影響等に知見を有する産官学の専門家グループの一員として、「よきAI社会」を目指し倫理的フレームワークの議論を進めています。AI4Peopleの創立メンバとして、AI技術の倫理的な利用を促進するため、AI4Peopleが公開している4種のドキュメントへの寄稿や、科学委員会における共同座長(2023-2024)を務めるなどの活動をしています。

また、OECD(経済協力開発機構)、GPAI(The Global Partnership on Artificial Intelligence)、AISI(AI Safety Institute)へ参画し、AI技術の倫理的な利用の促進、国際標準化ISO/IEC、欧州標準化団体CEN-CENELEC、BSI(British Standard Institution)のメンバとして、AI標準規格の策定など、社会全体の利益に貢献する活動を続けています。

Ethics-by-DesignとAIガバナンス

社会価値・規範に沿った、社会に受け入れられるAIを提供するための技術を開発しています。

技術:AI倫理影響評価

AIサービスの設計前に、AI倫理課題を特定・評価する技術です。AI倫理ガイドラインに基づいて、AIシステムに発生する可能性がある倫理的なリスクを系統的に分析することができます。

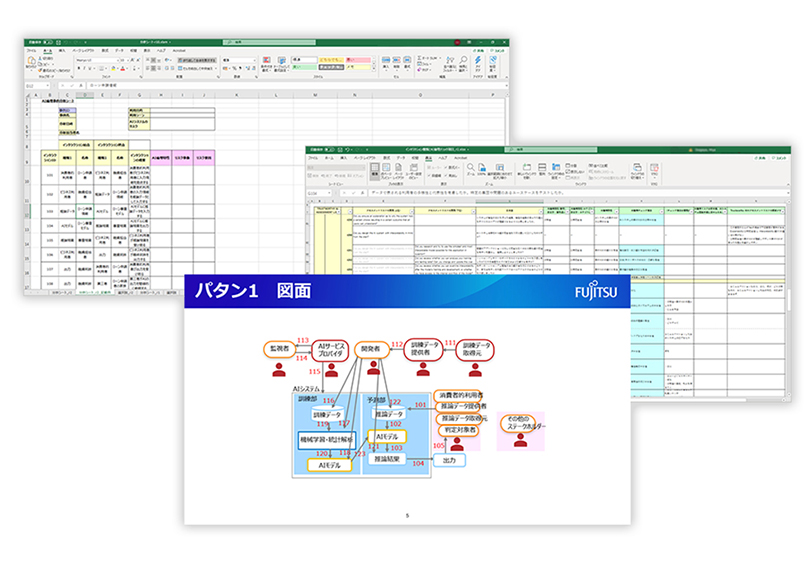

実践ガイド

AI倫理影響評価を実施するための手順書およびシートや図面を、実践ガイドとして公開しています。

AI倫理影響評価ツールキット

AI倫理影響評価の作業時間を短縮可能なツールキットをFujitsu Kozuchi *にて公開しました。お試しご希望の場合はお問い合わせください。

*このページは、毎週木曜日10:00 - 13:00はサイトメンテナンスのためご利用いただけません。

ホワイトペーパー

AIシステムの開発者、提供者、さらにAIシステムを利用するお客様に向けた、信頼できるAIを社会に普及させるための「AI倫理影響評価」について説明したドキュメントです。

適用事例集

さまざまな事例にAI倫理影響評価を適用してみました。AIシステムの開発者、提供者、さらにAIシステムを利用するお客様にとって、倫理的な問題が起こり得ることを認識するきっかけとなるドキュメントです。

技術:Fujitsu AI Ethics for Fairness

AIの学習データや判断の公平性を、Webブラウザの簡単な操作で検証したり、学習時のバイアスを低減し公平性を改善することが可能です。気づきにくい組合せのバイアス(交差バイアス)も扱うことができます。さらに、この技術はAutoML技術と組み合わされており、公平さと予測精度を同時に最適化するモデルを自動的に構築することができます。

技術:AIリスクマネジメントツール

AIのライフサイクルの各フェーズに潜む倫理・品質・セキュリティについてのリスクをコントロールするための機能を提供し、法律やガイドラインへの準拠や、適正なリスクマネジメントがおこなわれたことを証明するサポートができます。

活動:OSS活動

非営利の技術コンソーシアムLinux Foundationにて、自動機械学習技術とAI公平性技術をOSS化しました。

活動:産学連携

グラスゴー大学との共同研究(2019~):人材交流でかねてより連携していたグラスゴー大学と、AIの公平性についての共同研究を開始しました。これに続いて、Humanインタラクション研究の専門家たちと、AI技術のの領域横断デーマについて、緊密な共同研究を継続しています。

ミュンヘン工科大学との共同研究(2022~2023):金融をはじめにいくつかの分野を担う人々とワークショップ形式で対話し、AI倫理の原則やガイドラインを守りつつ、産業成長につなげるAIアカウンタビリティ・フレームワークを提案しています。

生成AIに潜むバイアスへの対処

生成AIは、社会の大きな関心事となっています。2023年5月に広島で開催されたG7サミットでも、生成AIの開発や活用についての国際的なルールに関する議論がなされました。生成AIは便利で役に立つ一方で、誤情報や偏った情報(バイアス)を出力する可能性も懸念されています。そのため、AIを公平で安心して利用できるものにするための技術開発を行っています。

技術:Fujitsu LLMバイアス診断技術

LLMに潜在するバイアスを多様な視点で診断し、業務に適したLLM選択を支援する技術です。

LLMには、属性(例:性別、年齢)に基づくバイアスやステレオタイプ、社会や文化に基づくバイアスなどさまざまな倫理的問題が潜在します。この技術では、LLMに潜むバイアスを診断し、分かりやすく可視化します。

ホワイトペーパー

「AIトラストと、対話型生成AIにおける富士通のAIトラスト技術」 ― 生成AIを活用して競合性を高め、売り上げ増加やコスト削減を目指す企業にとってもAIトラストは重要な課題です。AIへの信頼の実現に向けた富士通の活動と、AIトラスト技術を説明しています。

社会課題への取り組み

私たちはAI技術者・研究者として、より多くの人にとって、より良い社会の実現を目指し、ジェンダー平等の課題に取り組んでいます。

活動:お茶の水女子大学との共同研究

富士通のAI倫理技術と、お茶の水女子大学のジェンダー平等の課題についての研究知見をもとに、AIを活用した定量的かつ客観的なジェンダー平等施策を可能にする共同研究を行っています。共同研究を通じて得られた知見と、富士通のAI技術を活用することで、自らの人的資本経営へのトランスフォーメーションに貢献します。

AIに関わる方は必修!AI倫理を考える(連載 全6回)

AIを安心・安全に設計・開発・運用するために、どのようなことを考えていかなければならないのか、事例をふまえながら分かりやすくお話します。